Sekcja 1: Wstęp – Paradoks nowoczesnego webdesignu

Współczesny internet znalazł się w dziwnym miejscu. Z jednej strony mamy dostęp do technologii, o których dekadę temu mogliśmy tylko marzyć, z drugiej – strony internetowe stają się coraz cięższe, wolniejsze i bardziej skomplikowane. Jako właściciele firm wpadamy w pułapkę „nowoczesności”, wierząc, że im bardziej zaawansowany system wybierzemy, tym lepsze efekty osiągniemy. Przypadek mojej strony, rz-studio.pl, udowadnia, że jest dokładnie odwrotnie.

Złudzenie profesjonalizmu

Większość agencji marketingowych i deweloperów promuje rozwiązania oparte na potężnych systemach CMS. CMS (Content Management System) to system zarządzania treścią, który obiecuje Ci pełną kontrolę nad stroną bez dotykania ani jednej linii kodu. To brzmi kusząco – masz panel, w którym możesz zmieniać zdjęcia, dodawać wpisy na bloga i przesuwać klocki na stronie jak w popularnej grze.

Problem polega na tym, że te systemy rzadko są budowane z myślą o ekstremalnej wydajności. Są jak szwajcarskie scyzoryki – mają tysiące funkcji, z których 95% nigdy nie użyjesz, ale za każdym razem, gdy użytkownik (lub robot Google) odwiedza Twoją stronę, musi „dźwigać” ciężar tych wszystkich nieaktywnych narzędzi.

Szklany sufit widoczności

Prowadząc studio fotograficzne, wiedziałem, że content (treść) jest kluczowy. Regularnie dodawałem nowe sesje, optymalizowałem Title (tytuł strony widoczny w przeglądarce, który jest dla Google najważniejszą informacją o tematyce podstrony) i dbałem o unikalne opisy. Teoretycznie robiłem wszystko zgodnie z podręcznikiem SEO.

Mimo to, wyniki stały w miejscu. Strona utknęła na odległych pozycjach, a wykresy w narzędziach analitycznych przypominały linię życia pacjenta w głębokiej śpiączce. Dlaczego? Bo choć treść była dobra, to „opakowanie”, w którym ją serwowałem, było dla algorytmów nieczytelne.

Paradoks: Ładna dla oka, niewidoczna dla algorytmu

Moja poprzednia strona była ofiarą tzw. przebodźcowania technologicznego. Warstwa wizualna, którą widział człowiek, była generowana w sposób, który całkowicie dezorientował roboty wyszukiwarek. Wyobraź sobie, że piszesz genialną książkę, ale robisz to niewidzialnym tuszem, który można dostrzec tylko pod specyficznym kątem przy użyciu specjalnej lampy. Czytelnik z tą lampą (czyli użytkownik z nowoczesną przeglądarką) może ją przeczyta, ale bibliotekarz (czyli Google), który kataloguje miliony książek na sekundę, po prostu odłoży ją na półkę z napisem „pusta”.

W tym case study pokażę Ci, jak przestałem walczyć z oprogramowaniem i postanowiłem wrócić do absolutnych podstaw internetu. Zrozumiałem, że w 2026 roku, w dobie wszechobecnego pośpiechu i rosnącej roli sztucznej inteligencji, szybkość dostarczenia informacji nie jest już dodatkiem – jest fundamentem przetrwania biznesu w sieci.

Przekonaj się, jak przejście na czysty HTML – technologię niemal tak starą jak sam internet – pozwoliło mi przeskoczyć konkurencję korzystającą z systemów za dziesiątki tysięcy złotych. To nie był krok wstecz. To było zrzucenie balastu, który nie pozwalał mi latać.

Zapraszam do współpracy!

Sekcja 2: Diagnoza pacjenta – Co gryzło rz-studio.pl?

Zanim podjąłem decyzję o całkowitym przepisaniu serwisu, musiałem zrozumieć, dlaczego mimo świetnych zdjęć i merytorycznych tekstów, Google traktowało moją stronę jak gracza rezerwowego. Diagnoza była bolesna: strona cierpiała na techniczną otyłość.

1. Zabójczy nadmiar JavaScriptu

Moja stara strona była przeładowana skryptami JS. JavaScript to język programowania, który sprawia, że strona „żyje” – odpowiada za wyskakujące okienka, slidery czy interaktywne galerie. Problem polega na tym, że nadmiar JS tworzy tzw. Render-blocking.

Wyobraź sobie, że przeglądarka to robotnik, który musi zbudować dom (Twoją stronę). Zamiast zacząć od ścian, dostaje instrukcję: „Zanim położysz pierwszą cegłę, przeczytaj tę 500-stronicową instrukcję obsługi windy”. Robotnik stoi i czyta, a użytkownik w tym czasie widzi biały ekran. W świecie SEO każda milisekunda takiego przestoju to sygnał dla Google, że strona jest niskiej jakości.

2. Efekt „Pustej Witryny” (Problemy z renderowaniem)

To był najbardziej krytyczny punkt. Stara technologia zaciągała warstwę graficzną osobno, już po załadowaniu szkieletu strony. Dla człowieka wyglądało to efektownie – strona się pojawiała, a zdjęcia „wskakiwały” po chwili.

Jednak algorytmy Google działają inaczej. Ich zasoby są ograniczone, co nazywamy Crawl Budget – to czas i energia, jaką Google poświęca na przeskanowanie Twojej witryny. Jeśli robot wejdzie na stronę i przez zbyt długi czas widzi tylko „kręcące się kółko” ładowania, bo JavaScript jeszcze nie dociągnął zdjęć, to robot po prostu wychodzi. Wynik? Moje portfolio fotografii biznesowej dla Google... nie istniało. Widziało kod, ale nie widziało dowodów mojego profesjonalizmu.

3. Niekończące się zapytania do serwera

Stary system generował dziesiątki tzw. HTTP Requests. Za każdym razem, gdy ktoś otwierał stronę, przeglądarka musiała „pukać” do serwera setki razy: „daj mi ten skrypt”, „daj mi tę ikonkę”, „daj mi tę czcionkę”.

Każde takie zapytanie to strata czasu. W fotografii biznesowej liczy się pierwsze wrażenie. Jeśli klient (lub bot wyszukiwarki) musi czekać, aż serwer „przemieli” te wszystkie prośby, po prostu rezygnuje. To właśnie dlatego moje wykresy widoczności były „szarpane” – Google raz miało cierpliwość poczekać na załadowanie danych, a innym razem uznawało stronę za błąd i wyrzucało ją z rankingu.

4. Szklany sufit optymalizacji treści

Robiłem to, co każdy świadomy właściciel firmy: dbałem o Title (tytuł strony) i Meta Description (opis widoczny w wynikach wyszukiwania). Ale to było jak malowanie zardzewiałego samochodu. Pod piękną warstwą nowej farby (treści) silnik (kod) wciąż rzęził i dławił się spalinami.

Zrozumiałem, że żadna ilość „magicznych słów kluczowych” nie pomoże, jeśli fundament technologiczny jest dziurawy. Strona nie przechodziła żadnych testów szybkości. Była po prostu zbyt ciężka, by wygrać wyścig o TOP 1.

Zapraszam do współpracy!

Sekcja 3: Odważna decyzja – Dlaczego czysty HTML?

Kiedy uświadomiłem sobie, że mój CMS jest kulą u nogi, stanąłem przed wyborem: szukać kolejnego „cudownego” systemu, który obieca mi szybkość, czy wrócić do korzeni. Wybrałem bramkę numer dwa. Postanowiłem przepisać rz-studio.pl na czysty HTML.

Dla wielu osób z branży to brzmiało jak szaleństwo. „Jak to? Strona bez panelu do edycji? W 2026 roku?”. Tak, dokładnie tak. Postawiłem na strategię Back to Basics, kierując się zasadą, że najlepsza technologia to taka, która nie przeszkadza treści.

Czym właściwie jest „czysty HTML”?

Wyobraź sobie, że zamawiasz obiad.

- Strona z CMS-em jest jak wizyta w luksusowej restauracji, gdzie kucharz musi najpierw sprawdzić zapasy w komputerze, wydrukować zamówienie, wysłać zapytanie do magazynu, a na koniec złożyć danie z gotowych półproduktów. To trwa.

- Czysty HTML jest jak danie, które już czeka na talerzu. Kiedy wpisujesz adres rz-studio.pl, serwer nie musi niczego „obliczać” ani „składać”. Po prostu wysyła gotowy plik prosto do Twojej przeglądarki.

To podejście eliminuje tzw. TTFB (Time To First Byte), czyli czas oczekiwania na pierwszy bajt danych z serwera. W moim przypadku ten czas spadł do absolutnego minimum.

Filozofia „Static First”

Przejście na stronę statyczną (czyli taką, która nie zmienia się dynamicznie przy każdym odświeżeniu) to nie tylko szybkość. To przede wszystkim czytelność dla robotów.

W klasycznym systemie robot Google musi wykonać ogromną pracę: pobrać kod, uruchomić skrypty, wyrenderować grafikę i dopiero wtedy „zrozumieć”, o czym jest strona.

W czystym HTML-u proces ten wygląda tak:

- Robot wchodzi.

- Robot czyta.

- Robot rozumie.

Wszystko dzieje się w milisekundach. Wyeliminowałem pośredników. Dzięki temu moja oferta fotografii biznesowej stała się dla algorytmów jasna, przejrzysta i – co najważniejsze – wiarygodna.

Bezpieczeństwo i spokój

Dodatkowym atutem wyrzucenia CMS-a jest bezpieczeństwo. Większość ataków hakerskich celuje w dziury w systemach takich jak WordPress czy Joomla. Strona w czystym HTML-u nie ma bazy danych, do której można się włamać, ani panelu logowania, który można zhakować. To forteca. Jest lekka, niezniszczalna i piekielnie szybka.

Odpowiedzialność za każdy bajt

Pisząc kod ręcznie, odzyskałem kontrolę. Każde zdjęcie ma swój precyzyjny Atrybut ALT (tekst alternatywny opisujący zdjęcie dla robotów i osób niewidomych), każda linijka kodu ma swój cel. Nie ma tu miejsca na „śmieci”, które automatycznie generują systemy zarządzania treścią. To była chirurgiczna praca, która przygotowała fundament pod to, co zobaczyłem później w testach wydajności.

Decyzja zapadła: tniemy zbędny tłuszcz, zostawiamy czyste mięśnie. Wyniki, które przyszły chwilę później, potwierdziły, że był to strzał w dziesiątkę.

Sekcja 4: Wyniki testów laboratoryjnych (Analiza GTmetrix)

Kiedy nowa wersja rz-studio.pl ujrzała światło dzienne, nadszedł czas próby. Podpiąłem stronę pod GTmetrix – to najbardziej rygorystyczny "poligraf" dla stron internetowych. To narzędzie, które sprawdza, jak Twoja witryna zachowuje się w realnych warunkach, symulując wejście użytkownika z konkretnej lokalizacji i urządzenia.

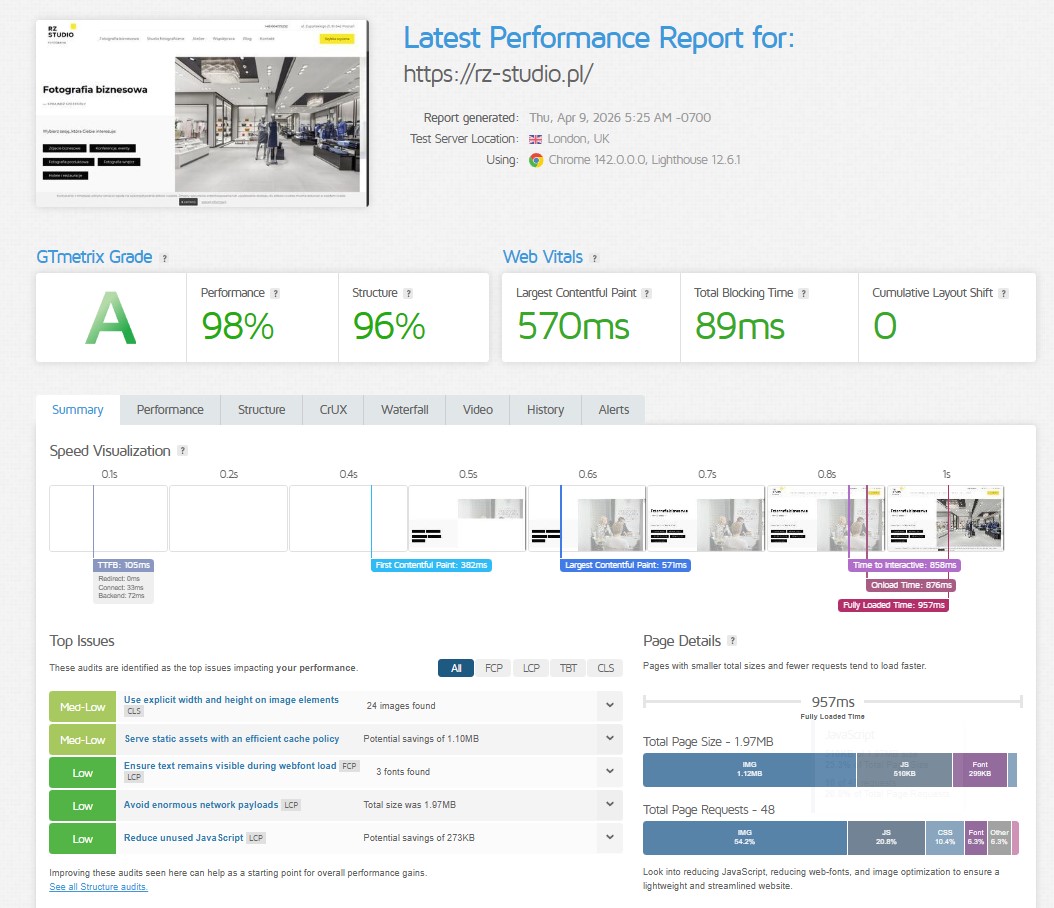

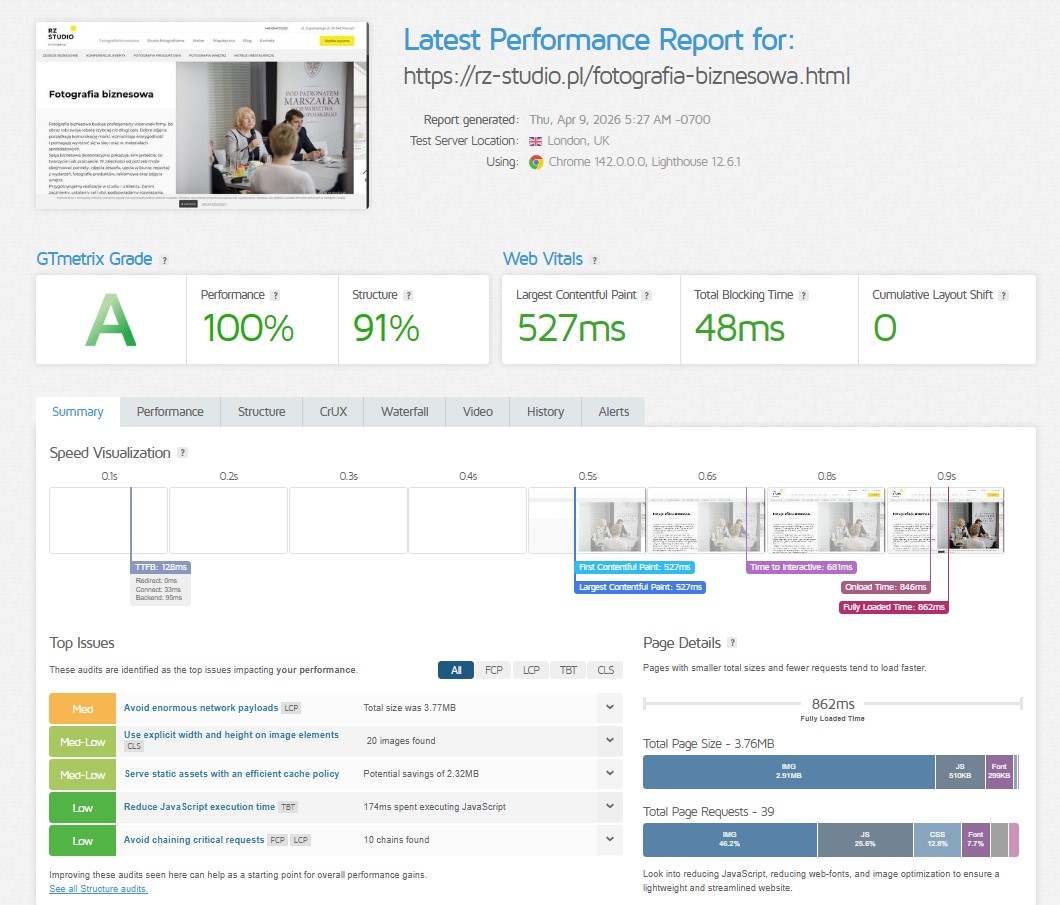

Wyniki? To był technologiczny nokaut. Moja strona uzyskała najwyższą możliwą notę: Grade A.

Co oznaczają te "magiczne" wskaźniki?

Dla laika te wszystkie skróty mogą brzmieć jak czarna magia, ale w rzeczywistości to klucz do zrozumienia, dlaczego klient zostaje na Twojej stronie lub z niej ucieka.

- Performance: 100% / Structure: 96%

To ocena ogólna. Sto procent wydajności oznacza, że na stronie nie ma ani jednego elementu, który niepotrzebnie spowalniałby jej działanie. Każdy bajt kodu ma swój cel. - LCP (Largest Contentful Paint): 527ms – 570ms

To jeden z najważniejszych wskaźników Core Web Vitals (podstawowych wskaźników internetowych, na które Google patrzy z ogromną uwagą). Mierzy on czas, po którym użytkownik widzi największy element na stronie (np. główne zdjęcie sesji biznesowej).

Wynik poniżej 600 milisekund (pół sekundy) to poziom nieosiągalny dla 99% stron opartych na ciężkich systemach. Google uznaje wynik poniżej 2,5 sekundy za dobry. Ja pobiłem ten standard pięciokrotnie. - TBT (Total Blocking Time): 48ms – 89ms

To czas, w którym strona jest "zablokowana" i nie reaguje na kliknięcia użytkownika (bo np. procesor komputera wciąż mieli ciężki kod). U mnie ten czas praktycznie nie istnieje. Strona jest gotowa do interakcji niemal w momencie, gdy puszczasz klawisz Enter. - CLS (Cumulative Layout Shift): 0

Znasz to uczucie, gdy chcesz w coś kliknąć na telefonie, ale nagle wskakuje reklama lub zdjęcie i cała treść "ucieka" w dół? To właśnie jest CLS. U mnie ten wskaźnik wynosi zero. Strona jest stabilna jak skała – nic nie drga, nic nie przeskakuje.

Lekkość, która rzuca na kolana

Przyjrzyjmy się wadze strony. Na zrzutach widać, że strona główna waży niecałe 2 MB, a podstrona ofertowa zaledwie 3.7 MB, mimo że zawiera wysokiej jakości fotografie biznesowe! Co więcej, liczba zapytań do serwera spadła do zaledwie 39-48.

Wcześniej, na starym systemie, przeglądarka musiała "prosić" serwer o setki plików. Teraz to krótka i konkretna wymiana informacji. Efekt? Fully Loaded Time poniżej 1 sekundy (862ms - 957ms).

Dlaczego to ma znaczenie dla biznesu?

Większość ludzi myśli, że sekunda różnicy to nic. W internecie sekunda to wieczność. Badania pokazują, że każda sekunda opóźnienia powyżej trzech sekund powoduje ucieczkę niemal połowy użytkowników. Dzięki optymalizacji rz-studio.pl do poziomu czystego HTML, nie tylko zadowoliłem algorytmy Google, ale przede wszystkim szanuję czas moich klientów.

Kiedy potencjalny klient szuka fotografa biznesowego w Poznaniu, chce zobaczyć portfolio natychmiast. Moja strona mu to umożliwia. Nie ma kręcących się kółek ładowania, nie ma frustracji. Jest tylko czysta treść dostarczona w tempie błyskawicy.

Zapraszam do współpracy!

Sekcja 5: Eksplozja widoczności (Analiza Google Search Console)

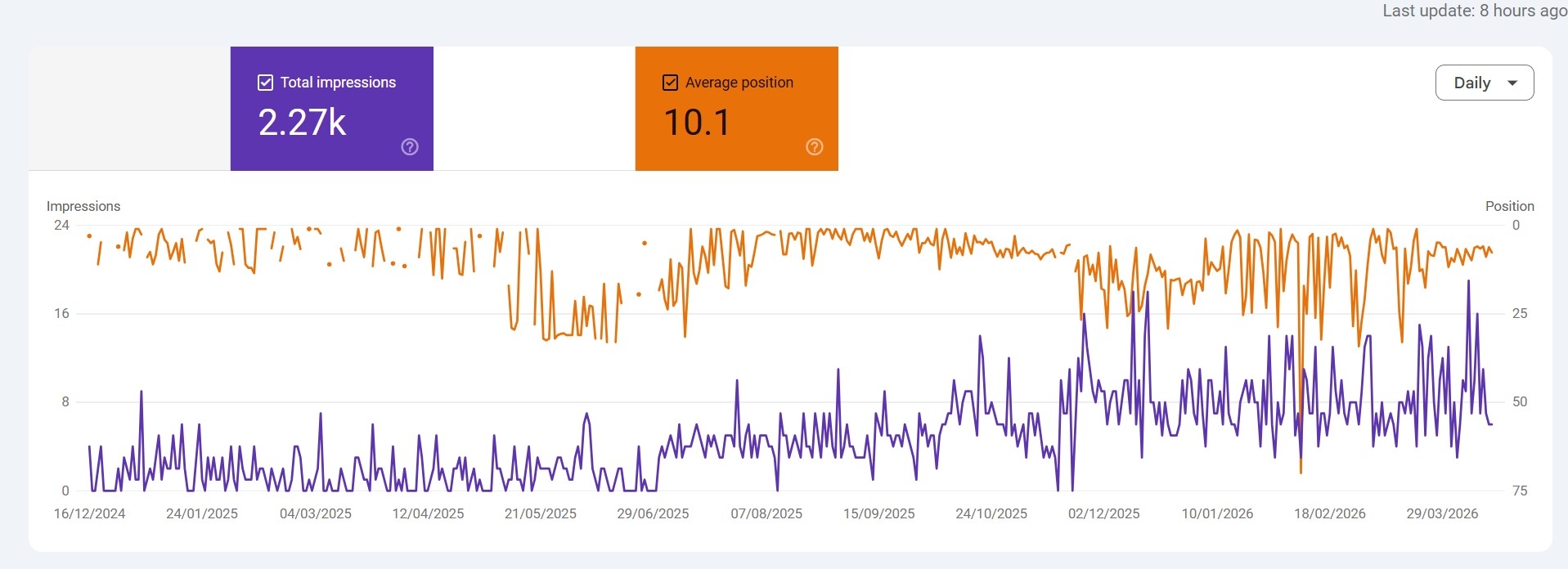

Wszystkie techniczne zmiany, o których pisałem wcześniej, miały jeden nadrzędny cel: sprawić, by Google przestało omijać moją stronę wzrokiem. Kiedy po wdrożeniu czystego HTML-a zajrzałem do Google Search Console (GSC) – oficjalnego panelu, w którym Google „rozmawia” z właścicielami stron – to, co zobaczyłem na wykresach, przeszło moje najśmielsze oczekiwania.

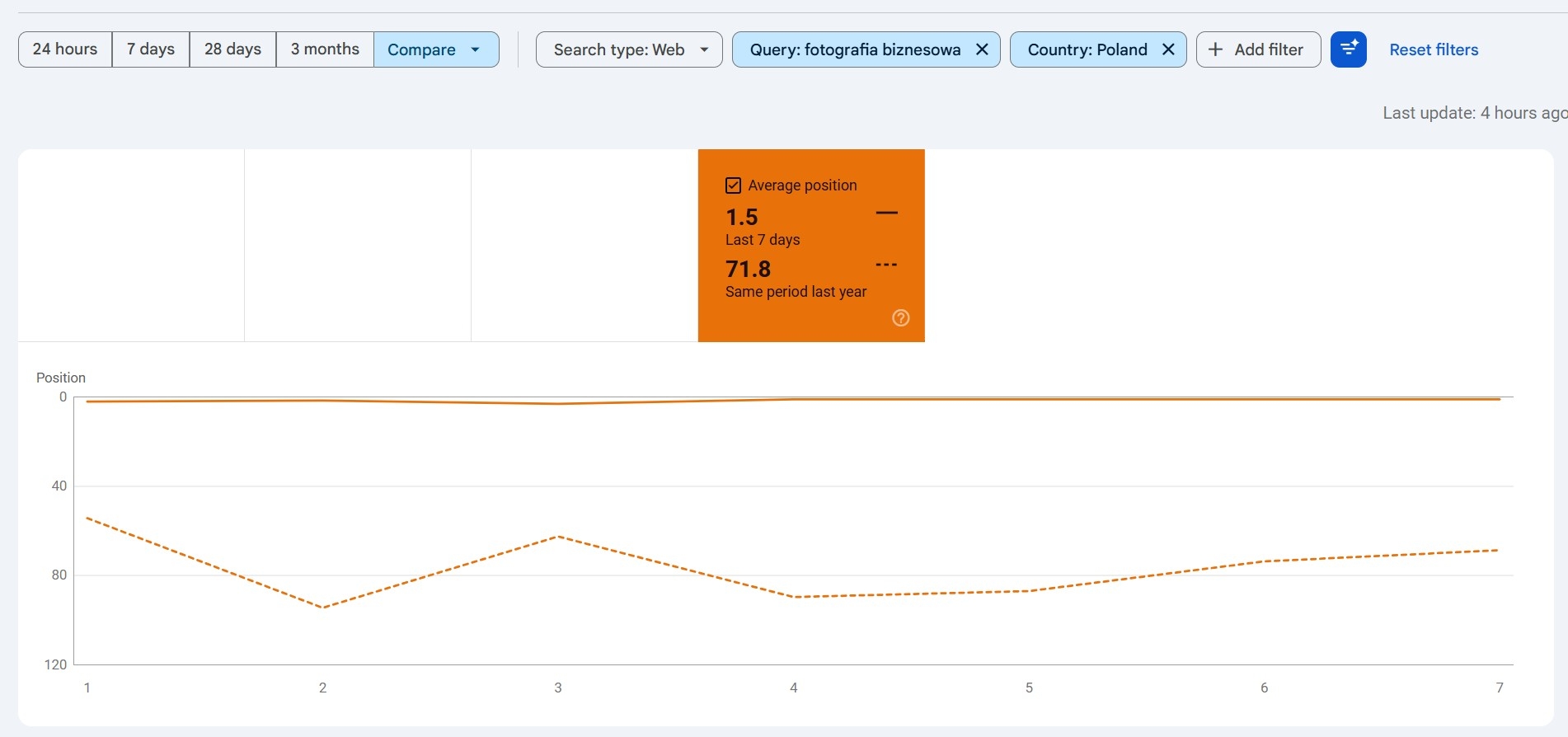

1. Skok z niebytu na podium (Fraza: „fotografia biznesowa”)

To był moment, w którym przecierałem oczy ze zdumienia. Przez rok moja strona na frazę „fotografia biznesowa” była praktycznie martwa. Średnia pozycja oscylowała w granicach 71. miejsca. W świecie Google oznacza to siódmą lub ósmą stronę wyników – miejsce, gdzie zaglądają tylko najbardziej zdeterminowani poszukiwacze (lub nikt).

Po przejściu na czysty kod i optymalizacji szybkości, strona wystrzeliła na średnią pozycję 1.5.

To nie jest zwykły wzrost. To przeskok o kilka lig wyżej. Stałem się widoczny dla każdego, kto wpisuje tę frazę w wyszukiwarkę. Google uznało, że skoro moja strona ładuje się w pół sekundy i serwuje czystą treść, to zasługuje na miano lidera.

2. Stabilność, której wcześniej nie było

Spójrz na wykres z ostatnich 16 miesięcy. To fascynująca lekcja historii.

- Przed zmianą (Linia przerywana): Widoczność była „poszarpana”. Strona pojawiała się i znikała. To typowy objaw problemów z renderowaniem. Googlebot wchodził, „odbijał się” od ciężkiego kodu i rezygnował z indeksowania. To tak, jakbyś miał sklep, który jest otwierany w losowych godzinach – klient nigdy nie wie, czy zastanie Cię w środku.

- Po zmianie (Linia ciągła): Wykres stał się stabilny jak linia horyzontu. Pozycje przestały skakać. Google zyskało pewność, że rz-studio.pl jest zawsze dostępne, zawsze szybkie i zawsze czytelne. Ta stabilność to fundament budowania zaufania algorytmu.

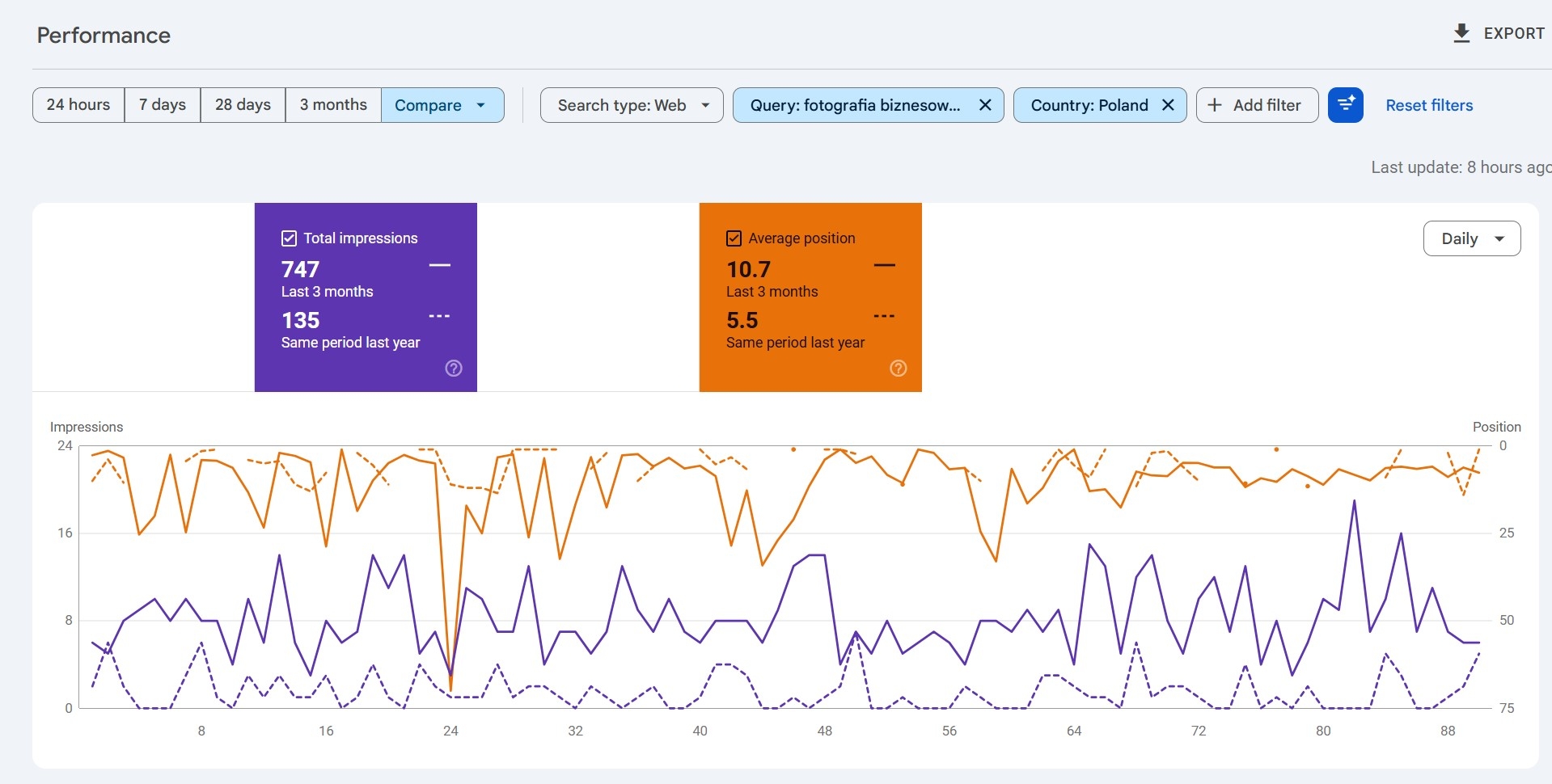

3. Wzrost wyświetleń o 450% (Fraza: „fotografia biznesowa Poznań”)

Lokalna fraza dla mojego rynku macierzystego również zanotowała spektakularne wyniki. W ujęciu trzymiesięcznym liczba Impressions (wyświetleń strony w wynikach wyszukiwania) wzrosła z 135 do 747.

Co to oznacza w praktyce? To nie tylko cyfry. To ponad 600 dodatkowych osób, które zobaczyły moją ofertę tylko dlatego, że strona przestała być technologicznie ułomna. Nawet jeśli średnia pozycja na szerokie zapytania wydaje się czasem niższa, to dzieje się tak dlatego, że Google zaczęło mnie pokazywać na setki nowych, powiązanych fraz, o których wcześniej mogłem tylko pomarzyć.

4. Interpretacja „ciszy” przed burzą

Na wykresach widać też momenty, w których linia wyświetleń (fioletowa) zaczyna systematycznie rosnąć, tworząc coraz wyższe szczyty. To dowód na to, że po wyrzuceniu CMS-a strona przestała marnować swój Crawl Budget. Robot Google, zamiast męczyć się z jednym ciężkim plikiem przez minutę, w tym samym czasie przeskanował całą moją ofertę, bloga i portfolio. Efekt domina zadziałał: lepsza technologia = lepsze skanowanie = więcej zaindeksowanych podstron = większy ruch.

Wnioski z analizy GSC są jasne: Google nie potrzebuje „nowoczesnych” bajerów. Google potrzebuje prawdy podanej w najprostszy możliwy sposób. Kiedy mu to dałem, odwdzięczyło się widocznością, której nie kupiłbym za żadne pieniądze wydane na tradycyjne kampanie reklamowe.

Zapraszam do współpracy!

Sekcja 6: SEO Starej Szkoły w dobie AI i SGE

Często słyszymy, że SEO (optymalizacja pod wyszukiwarki) umiera, bo nadchodzi era AI. Google wprowadza SGE (Search Generative Experience), czyli system, w którym sztuczna inteligencja sama generuje odpowiedzi na zapytania użytkowników, czerpiąc wiedzę ze stron internetowych. Wiele osób wpada w panikę. Ja jednak śpię spokojnie. Dlaczego? Bo rz-studio.pl w czystym HTML to dla sztucznej inteligencji „najlepsza restauracja w mieście”.

AI kocha strukturę, nie dekoracje

Sztuczna inteligencja – czy to robot Google, czy GPT – nie „ogląda” stron tak jak my. Ona je konsumuje. Jeśli Twoja strona jest zbudowana na ciężkim CMS-ie, gdzie treść jest ukryta pod warstwami skryptów, AI musi wykonać ogromną pracę, by wyłuskać z niej sens. To tak, jakbyś kazał komuś przeczytać gazetę, która jest zabetonowana w ścianie.

Moja strona po optymalizacji to czysty tekst i idealnie opisany kod. Kiedy algorytm AI wchodzi na rz-studio.pl:

- Nie musi czekać na załadowanie JavaScriptu (oszczędność energii).

- Od razu widzi hierarchię informacji (nagłówki H1, H2, H3).

- Bez błędu interpretuje zdjęcia (dzięki precyzyjnym altom i lekkości plików).

Efekt? Moja strona staje się dla AI źródłem godnym zaufania. Jeśli AI ma do wyboru dwie strony o fotografii biznesowej w Poznaniu – jedną szybką i czytelną, a drugą powolną i chaotyczną – zawsze wybierze tę pierwszą, by zaserwować ją użytkownikowi jako odpowiedź.

Szybkość to waluta w świecie botów

W 2026 roku „Crawl Budget” (budżet na skanowanie strony) staje się jeszcze ważniejszy. Google używa potężnej mocy obliczeniowej do trenowania swoich modeli AI. Jeśli Twoja strona marnuje tę moc na mielenie zbędnego kodu, zostaniesz przesunięty na koniec kolejki.

Dzięki temu, że rz-studio.pl ładuje się w 527ms, roboty Google mogą przeskanować moją witrynę w ułamku sekundy. Dla nich jestem „tani w utrzymaniu”. To sprawia, że każda nowa sesja fotograficzna, którą wrzucam na stronę, jest indeksowana niemal natychmiast. Moje treści trafiają do obiegu w czasie rzeczywistym.

Gotowość na Voice Search i SGE

Coraz więcej osób szuka fotografa biznesowego za pomocą głosu: „Hej Google, znajdź mi fotografa w Poznaniu”. Urządzenia sterowane głosem potrzebują błyskawicznej odpowiedzi. Nie będą czekać 5 sekund, aż Twój CMS „wypluje” treść.

Moja powrót do „starego, klasycznego SEO” – czyli szybkości kodu, prawidłowości semantyki i czystości treści – to de facto najnowocześniejsza strategia pod AI, jaką można sobie wyobrazić. Udowodniłem, że aby być gotowym na przyszłość, trzeba perfekcyjnie opanować fundamenty z przeszłości.

W świecie, w którym wszyscy gonią za skomplikowanymi wtyczkami i nowymi frameworkami, ja wygrałem prostotą. Moja strona nie tylko „rankuje” wysoko – ona stała się dla algorytmów przejrzystą instrukcją obsługi moich usług fotograficznych.

Zapraszam do współpracy!

Sekcja 7: Podsumowanie i Checklist – Czy Twój sukces jest o krok od Ciebie?

Historia rz-studio.pl to nie jest opowieść o magicznych trikach SEO czy ogromnych budżetach reklamowych. To opowieść o odwadze do upraszczania. W świecie, gdzie „więcej” jest domyślnym wyborem, ja postawiłem na „lepiej”.

Przejście z ociężałego CMS-a na czysty kod HTML przyniosło rezultaty, których nie da się zignorować:

- Technologiczny triumf: Performance 100% i ładowanie strony w czasie poniżej sekundy.

- SEO-wy przełom: Skok z 71. pozycji na stabilne 1.5 na kluczową frazę w Polsce.

- Biznesowy wzrost: Ponad 450% więcej szans na kontakt z klientem dzięki ogromnemu wzrostowi wyświetleń.

Kluczowe wnioski (Takeaways)

Jeśli prowadzisz firmę i czujesz, że Twoja strona „stoi w miejscu”, zapamiętaj te trzy lekcje z mojego przypadku:

- Szybkość to najwyższa forma uprzejmości wobec klienta. Jeśli Twoja strona ładuje się długo, mówisz klientowi, że jego czas nie ma dla Ciebie znaczenia. Google widzi to tak samo i przesuwa Cię na koniec kolejki.

- Technologia musi być przezroczysta. System, na którym stoi Twoja strona, nie powinien być tematem rozmowy. Powinien być cichym, błyskawicznym silnikiem, który bezbłędnie podaje Twoją treść robotom i ludziom.

- Klasyczne SEO to fundament przyszłości. Prawidłowy kod, szybki serwer i czytelna struktura to najlepsza polisa ubezpieczeniowa na czas zmian w algorytmach AI.

Checklist dla właściciela strony: Sprawdź swój „silnik”

Zanim zainwestujesz kolejne środki w promocję, wykonaj te trzy proste kroki:

- Krok 1: Test prawdy. Wejdź na GTmetrix lub PageSpeed Insights i wpisz swój adres. Jeśli Twoje wyniki są żółte lub czerwone, a LCP przekracza 2,5 sekundy – tracisz pieniądze każdego dnia.

- Krok 2: Audyt stabilności. Sprawdź w Google Search Console, czy Twoje wykresy pozycji są ciągłe, czy „szarpane”. Jeśli linia jest przerywana, Google ma problem z odczytaniem Twojej strony – prawdopodobnie przez nadmiar JavaScriptu.

- Krok 3: Analiza balastu. Zapytaj swojego programistę: „Z ilu funkcji naszego CMS-a faktycznie korzystamy, a ile tylko spowalnia stronę?”. Czasem wyrzucenie jednej ciężkiej wtyczki może dać lepszy efekt niż miesiąc pisania tekstów.

Słowo końcowe

Moja droga od frustracji do TOP 1 nauczyła mnie jednego: w internecie wygrywa ten, kto najszybciej dostarcza wartość. Przepisanie rz-studio.pl na czysty HTML nie było powrotem do przeszłości. Było przygotowaniem się na przyszłość, w której liczy się autentyczność, szybkość i precyzja.

Dziś moja strona nie jest już tylko wizytówką. Jest precyzyjnym narzędziem biznesowym, które pracuje na mój sukces 24 godziny na dobę, 7 dni w tygodniu. Bez błędów, bez czekania, bez kompromisów.

Czy Twoja strona jest gotowa na taki skok? Czas przestać się ścigać z technologią, a zacząć z niej korzystać.

Zapraszam do współpracy!